Proses File Excel Raksasa di Laravel Tanpa Error (Cara Aman & Efisien)

Halo, para Laravel developer!

Pernahkah Kamu mengalami situasi di mana Kamu harus mengimpor data dari file Excel yang lumayan besar? Mungkin saja data pengguna, data produk, atau laporan penjualan yang mencapai 1000, 2000, atau bahkan lebih baris.

Kamu mencoba cara yang paling sederhana: membaca file, lalu melakukan loop foreach untuk setiap baris. Saat dijalankan… BOOM!

Fatal error: Allowed memory size of 134217728 bytes exhausted (tried to allocate 20480 bytes)Atau mungkin ini?

Maximum execution time of 60 seconds exceededFrustrasi, bukan? Error ini adalah mimpi buruk bagi setiap developer yang menangani pemrosesan file besar. Tapi jangan khawatir, di Laravel ada solusi yang elegan dan efisien untuk masalah ini.

Pada tutorial ini, kita akan belajar cara memproses file Excel dengan ribuan baris data secara aman, tanpa memakan banyak memori, dan tanpa membuat pengguna menunggu lama. Kita akan menggunakan package andalan di Laravel: Maatwebsite Laravel Excel.

Daftar Isi

- Mengapa Cara “Biasa” Gagal?

- Langkah 1: Persiapan dan Instalasi

- Langkah 2: Membuat Skenario Impor Data

- Langkah 3: Membuat Kelas Import

- Langkah 4: Implementasi Chunking

- Langkah 5: Meningkatkan Keandalan dengan Batching

- Langkah 6: Mengintegrasikan di Controller

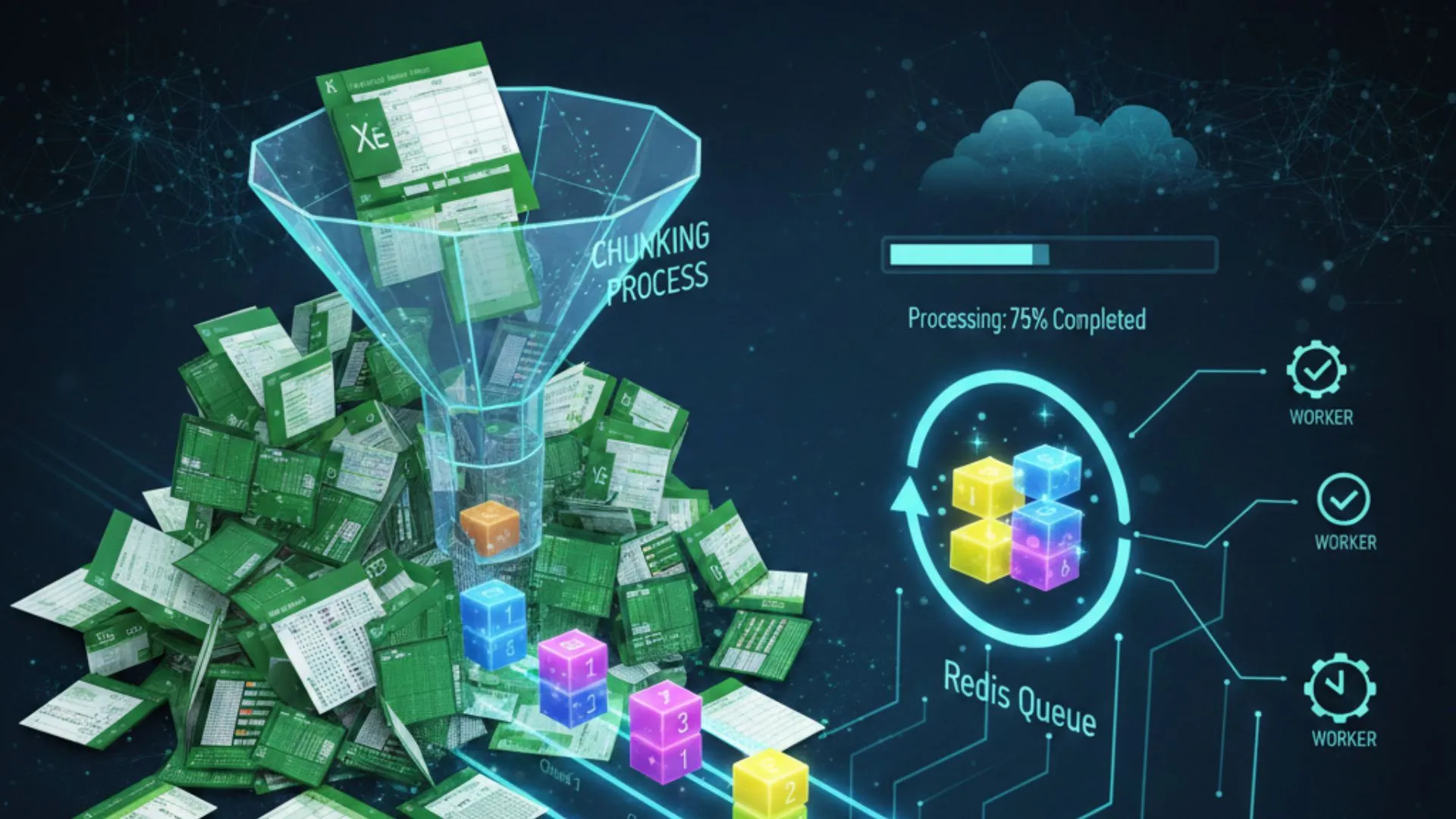

- Bonus: Solusi Terbaik - Proses di Background dengan Queue

- Kesimpulan

Mengapa Cara “Biasa” Gagal?

Sebelum kita ke solusi, mari kita pahami dulu akar masalahnya.

- Memory Exhaustion (Kehabisan Memori): Cara standar membaca file Excel adalah memuat seluruh isi file ke dalam memori RAM server sekaligus. Bayangkan, satu baris data di Excel bisa saja memakan 10KB memori. Dengan 2000 baris, Kamu sudah butuh 20MB hanya untuk menyimpan data di memori, belum lagi proses lainnya. Ini yang menyebabkan error

Allowed memory size exhausted. - Script Timeout (Waktu Eksekusi Habis): PHP memiliki batas waktu maksimum untuk eksekusi skrip (biasanya 30-60 detik). Jika proses loop untuk 2000 baris membutuhkan waktu lebih dari itu, skrip akan terhenti dan menghasilkan error

Maximum execution time exceeded.

Solusinya bukan menaikkan limit memori atau waktu eksekusi (itu hanya menutupi masalah, bukan mengatasinya), tapi mengubah cara kita memproses file. Konsepnya sederhana: Jangan makan semuanya sekaligus, kunyah sedikit-sedikit. Konsep ini disebut Chunking.

Langkah 1: Persiapan dan Instalasi

Pastikan Kamu sudah memiliki project Laravel. Jika belum, buat baru dengan composer create-project laravel/laravel nama-project.

Kita akan menginstal package Laravel Excel. Buka terminal di direktori project Kamu dan jalankan perintah:

composer require maatwebsite/excelPackage ini akan otomatis terdaftar di Laravel. Untuk versi Laravel yang lebih lama, Kamu mungkin perlu menambahkan ServiceProvider dan alias di config/app.php, namun untuk Laravel modern, ini tidak lagi diperlukan.

Langkah 2: Membuat Skenario Impor Data

Agar tutorial ini nyata, kita akan membuat skenario mengimpor data Product dari file Excel.

1. Buat Model dan Migration untuk Product:

php artisan make:model Product -mBuka file migration yang baru dibuat di database/migrations/ dan sesuaikan strukturnya.

// database/migrations/xxxx_xx_xx_xxxxxx_create_products_table.php

public function up()

{

Schema::create('products', function (Blueprint $table) {

$table->id();

$table->string('name');

$table->string('category');

$table->integer('price');

$table->timestamps();

});

}Jangan lupa jalankan migration:

php artisan migrateLangkah 3: Membuat Kelas Import

Package Laravel Excel memiliki perintah artisan untuk membuat kelas import. Ini adalah cara yang paling terstruktur.

php artisan make:import ProductsImport --model=ProductPerintah ini akan membuat file app/Imports/ProductsImport.php. Mari kita buka dan lihat isinya.

Secara default, kelas ini memiliki metode model() yang akan membuat instance Product untuk setiap baris. Namun, untuk fleksibilitas yang lebih baik (misalnya untuk validasi atau logika khusus), kita akan menggunakan metode collection().

Ubah file ProductsImport.php menjadi seperti ini:

<?php

namespace App\Imports;

use App\Models\Product;

use Illuminate\Support\Collection;

use Maatwebsite\Excel\Concerns\ToCollection;

class ProductsImport implements ToCollection

{

/**

* @param Collection $collection

*/

public function collection(Collection $rows)

{

foreach ($rows as $row)

{

// Anggap baris pertama adalah header, jadi kita skip

if ($row[0] === 'Name') {

continue;

}

Product::create([

'name' => $row[0], // Kolom A

'category' => $row[1], // Kolom B

'price' => $row[2], // Kolom C

]);

}

}

}Penjelasan:

ToCollection: Interface ini memberi kita akses keCollectionLaravel untuk setiap baris (atau chunk) yang diproses.$row[0],$row[1],$row[2]: Ini adalah akses ke kolom di Excel.$row[0]adalah kolom A,$row[1]adalah kolom B, dan seterusnya.if ($row[0] === 'Name'): Ini adalah cara sederhana untuk melewati baris header di file Excel Anda.

Langkah 4: Implementasi Chunking (Solusi Masalah Memori)

Sekarang kita sampai pada bagian terpenting. Kita akan mengimplementasikan chunking agar memori tidak habis.

Caranya sangat mudah, kita hanya perlu menambahkan interface WithChunkReading ke kelas ProductsImport kita.

<?php

namespace App\Imports;

use App\Models\Product;

use Illuminate\Support\Collection;

use Maatwebsite\Excel\Concerns\ToCollection;

use Maatwebsite\Excel\Concerns\WithChunkReading; // Tambahkan ini

class ProductsImport implements ToCollection, WithChunkReading // Tambahkan interface ini

{

// ... metode collection() tetap sama ...

/**

* Menentukan ukuran chunk (jumlah baris per proses)

*

* @return int

*/

public function chunkSize(): int

{

return 500; // Proses 500 baris setiap kali

}

}Apa yang terjadi di sini?

Dengan menambahkan WithChunkReading dan mendefinisikan metode chunkSize(), kita memerintahkan Laravel Excel untuk:

- Membuka file Excel.

- Hanya membaca 500 baris pertama dan memuatnya ke memori.

- Melempar 500 baris ini ke metode

collection(). - Setelah selesai, buang 500 baris ini dari memori.

- Lanjut membaca 500 baris berikutnya, dan ulangi prosesnya hingga selesai.

Dengan cara ini, penggunaan memori akan tetap rendah dan stabil, tidak peduli seberapa besar file Excel Anda!

Langkah 5: Meningkatkan Keandalan dengan Batching

Apa yang terjadi jika ada satu baris data yang rusak di antara 500 baris yang kita proses? Proses insert database bisa gagal di tengah jalan, dan data kita menjadi tidak konsisten.

Solusinya adalah Batching. Dengan batching, kita bisa membungkus proses insert untuk setiap chunk ke dalam sebuah database transaction. Jika satu baris gagal, maka seluruh 500 baris di chunk tersebut akan dibatalkan (rollback).

Caranya, tambahkan interface WithBatchInserts.

<?php

namespace App\Imports;

use App\Models\Product;

use Illuminate\Support\Collection;

use Maatwebsite\Excel\Concerns\ToCollection;

use Maatwebsite\Excel\Concerns\WithChunkReading;

use Maatwebsite\Excel\Concerns\WithBatchInserts; // Tambahkan ini

class ProductsImport implements ToCollection, WithChunkReading, WithBatchInserts // Tambahkan interface ini

{

// ... metode collection() dan chunkSize() tetap sama ...

/**

* Menentukan ukuran batch. Harus sama dengan chunkSize.

*

* @return int

*/

public function batchSize(): int

{

return 500;

}

}Sekarang, setiap kali Laravel Excel memproses 500 baris, ia akan menjalankan semua query Product::create() di dalam satu transaksi database. Ini menjaga integritas data Anda.

Langkah 6: Mengintegrasikan di Controller

Terakhir, kita buat controller dan route untuk menangani upload file.

1. Buat Controller:

php artisan make:controller ProductController2. Tambahkan Method di ProductController.php:

<?php

namespace App\Http\Controllers;

use Illuminate\Http\Request;

use App\Imports\ProductsImport;

use Maatwebsite\Excel\Facades\Excel;

class ProductController extends Controller

{

public function showUploadForm()

{

return view('upload');

}

public function upload(Request $request)

{

// Validasi file

$request->validate([

'excel_file' => 'required|mimes:xlsx,xls,csv|max:2048', // Maks 2MB

]);

// Proses import

Excel::import(new ProductsImport, $request->file('excel_file'));

return redirect()->back()->with('success', 'Data produk berhasil diimpor!');

}

}3. Buat Route di routes/web.php:

use App\Http\Controllers\ProductController;

Route::get('/upload', [ProductController::class, 'showUploadForm'])->name('upload.form');

Route::post('/upload', [ProductController::class, 'upload'])->name('upload.process');4. Buat View resources/views/upload.blade.php:

<!DOCTYPE html>

<html lang="en">

<head>

<meta charset="UTF-8">

<title>Upload Excel</title>

<!-- Tambahkan CSS jika perlu, misalnya Bootstrap -->

</head>

<body>

<h1>Upload File Excel Produk</h1>

@if(session('success'))

<div style="color: green;">

{{ session('success') }}

</div>

@endif

<form action="{{ route('upload.process') }}" method="POST" enctype="multipart/form-data">

@csrf

<div>

<label for="excel_file">Pilih File Excel:</label>

<input type="file" name="excel_file" id="excel_file" required>

</div>

<br>

<button type="submit">Import</button>

</form>

</body>

</html>Sekarang, coba akses /upload di browser, upload file Excel Anda, dan lihat hasilnya. Prosesnya akan jauh lebih cepat dan stabil!

Bonus: Solusi Terbaik - Proses di Background dengan Queue

Untuk file dengan 1000-2000 baris, metode chunking di atas sudah sangat cukup. Tapi bagaimana jika filenya 50.000 baris? Atau jika proses untuk setiap baris sangat kompleks (misalnya memanggil API eksternal)?

Pengguna masih akan menunggu di halaman browser sampai proses selesai, yang bisa menyebabkan timeout.

Solusi terbaik adalah memindahkan proses berat ini ke background queue.

1. Konfigurasi Queue Driver:

Buka .env dan ubah QUEUE_CONNECTION menjadi database.

QUEUE_CONNECTION=databaseBuat tabel untuk job queue:

php artisan queue:table

php artisan migrate2. Buat Kelas Import Bisa Diantrikan (ShouldQueue)

Kembali ke file ProductsImport.php, tambahkan interface ShouldQueue.

<?php

namespace App\Imports;

use App\Models\Product;

use Illuminate\Support\Collection;

use Maatwebsite\Excel\Concerns\ToCollection;

use Maatwebsite\Excel\Concerns\WithChunkReading;

use Maatwebsite\Excel\Concerns\WithBatchInserts;

use Illuminate\Contracts\Queue\ShouldQueue; // Tambahkan ini

class ProductsImport implements ToCollection, WithChunkReading, WithBatchInserts, ShouldQueue // Tambahkan interface ini

{

// ... semua metode lainnya tetap sama ...

}Itu saja! Sekarang, ketika Kamu memanggil Excel::import(), Laravel tidak akan memprosesnya langsung. Sebaliknya, ia akan memasukkan job ke dalam tabel jobs.

3. Jalankan Queue Worker

Agar job dijalankan, Kamu perlu menjalankan proses queue worker di terminal. Buka terminal baru dan jalankan:

php artisan queue:workSekarang, coba upload file lagi. Kamu akan langsung mendapatkan respons “Data produk berhasil diimpor!” (meskipun prosesnya belum selesai), dan di terminal queue:work, Kamu akan melihat log bahwa proses import sedang berjalan di background.

Kesimpulan

Memproses file besar bukan lagi mimpi buruk di Laravel. Dengan package Maatwebsite Laravel Excel dan strategi yang tepat, Kamu bisa melakukannya dengan aman dan efisien.

- Masalah:

memory limitdantimeout. - Solusi 1 (Bagus): Gunakan

WithChunkReadinguntuk memproses data secara bertahap dan menjaga penggunaan memori rendah. - Solusi 2 (Lebih Baik): Tambahkan

WithBatchInsertsuntuk menjaga integritas data dengan database transaction. - Solusi 3 (Terbaik): Implementasikan

ShouldQueueuntuk memproses file di background, memberikan pengalaman pengguna yang luar biasa dan menghilangkan masalah timeout sepenuhnya.

Selamat mencoba, dan semoga tidak ada lagi error memory exhausted yang menghantui kode Anda